Local Adjustments/fr

Texte original rédigé par Jacques Desmis (mise à jour 3 décembre 2022).

Les lecteurs de la version en langue française, peuvent s'étonner de voir les titres des rubriques, champs, bouton à cocher, etc. utiliser la langue anglaise, plutôt que le français, par exemple "Color & Light", au lieu de "Couleur & Lumière". C'est le résultat d'un compromis, pour plusieurs raisons:

- la totalité des échanges sur la mise au point de "Ajustements locaux" se fait en anglais (forum, issues, Pull Request), et donc la version à jour est obligatoirement celle en anglais (langue que je maîtrise très mal);

- je suis le seul rédacteur pour "Ajustements Locaux", "Local adjustments" de Rawpedia. Bien sûr la première version est rédigée en francais mais les captures d'écrans où on voit apparaître les réglages dans le panneau de droite, doivent être en anglais, car Rawpedia est complexe. Le faire en plusieurs langues m'aurait obligé à le faire aussi en allemand, espagnol, etc., d'où un travail considérable...que je ne sais évidemment pas faire, ce qui est impensable. En conséquence ce qui apparaît est en anglais (outils, curseurs, boites de dialogues, etc.);

Je souhaite bon courage aux traducteurs dans les autres langues!

J'espère que vous comprendrez ce compromis.

Merci

Jacques

Introduction

L'édition locale dans RawTherapee est basée sur des Spot RT, qui sont similaires dans leur principe au concept U-Point utilisé à l'origine dans Nikon Capture NX2, puis dans la Nik Collection, DxO PhotoLab et Capture NXD. Les RT-spots utilisent des algorithmes développés spécifiquement pour RawTherapee par Jacques Desmis.

Cette approche est complètement différente des méthodes d'édition locales plus familières utilisées dans des applications telles que GIMP, Photoshop, etc., qui utilisent principalement des outils de sélection tels que des lassos, des baguettes magiques, etc., associés à des pinceaux, des calques et des masques de fusion. Ces méthodes peuvent prendre du temps et être difficiles à utiliser avec précision lorsque des formes complexes sont impliquées.

Un point RT se compose soit d'une ellipse, soit d'un rectangle avec un cercle de diamètre variable au centre. Les formes ont quatre points de contrôle, qui peuvent être ajustés indépendamment ou symétriquement. Le spot rectangulaire peut également être utilisé en mode plein écran qui définit automatiquement les points de contrôle en dehors de la zone de prévisualisation de l'image. Les développements futurs fourniront une manipulation de forme améliorée.

L'algorithme RT-spot utilise une détection de forme basée sur ΔE (le changement de la perception visuelle de deux couleurs données) pour sélectionner les parties de l'image à modifier à l'intérieur de l'ellipse ou du rectangle. Les valeurs de référence utilisées pour l'algorithme de détection de forme sont basées sur la moyenne des valeurs de teinte, de saturation et de luminance à l'intérieur de l'ellipse ou du rectangle de taille variable. Cela signifie qu'en mode plein écran (ainsi qu'en mode Normal ou Exluding), ces valeurs et la détection de forme qui en découle peuvent varier en fonction de la position du cercle.

La mesure dans laquelle ces modifications sont appliquées peut être finement contrôlée permettant des sélections très précises. Un ajout supplémentaire est possible avec des masques paramétriques supplémentaires, mais les algorithmes de détection de forme devraient être suffisants pour la grande majorité des exigences d'édition locales. Les RT-spot peuvent également être utilisés en mode "excluding spot" pour empêcher l'algorithme d'influencer certaines parties de l'image. Les modifications pouvant être effectuées sont importantes et intègrent la plupart des fonctions disponibles dans les outils de réglage global de RawTherapee ainsi que quelques outils supplémentaires disponibles uniquement dans l'onglet Réglages locaux.

Remarque : tant que la case à cocher "Avoid Color Shift" dans le module Paramètres n'a pas été désactivée, les opérations suivantes seront effectuées sur les données avant et après l'activation de tout RT Spot.

- Une correction colorimétrique relative pour conserver les données dans le gamut.

- Une correction Munsell (qui peut être utilisée seule, sans le contrôle du gamut) utilisant des LUT pour garantir que les données restent linéaires et éviter les changements de teinte.

.

Les outils

Les outils sont regroupés dans les modules suivants (Nom de l'outil - position dans le pipeline) :

Color & Light - 11

Ajuste la couleur, la luminosité, le contraste et corrige les petits défauts tels que les yeux rouges, la poussière du capteur, etc. D'autres fonctions incluent un filtre gradué, des courbes L*a*b* et des modes de fusion.

Shadows/Highlights & Tone Equalizer - 6

Ajuste les ombres et les lumières avec les curseurs d'ombres/lumières, un égaliseur de tonalité (Tone Equalizer) ou une courbe de réponse de tonalité "Tone Response Curve (TRC)". Peut être utilisé à la place ou en conjonction avec le module d'exposition. Peut également être utilisé comme filtre gradué.

Vibrance & Warm/Cool - 5

Ajuste la vibrance (pratiquement identique à l'ajustement global). Effectue l'équivalent d'un réglage de la balance des blancs à l'aide d'un algorithme CIECAM.

Log Encoding - 0

Ajuste les images sous-exposées ou à plage dynamique élevée à l'aide d'un algorithme codé logarithme.

Dynamic Range & Exposure - 10

Modifie l'exposition dans l'espace L*a*b* à l'aide d'un algorithme à base de Laplacien PDE pour prendre en compte deltaE et minimiser les artefacts. Les opérateurs laplaciens sont utilisés car ils sont particulièrement bons pour détecter les détails fins mais vous n'avez pas besoin de comprendre leur fonctionnement pour utiliser cet outil !

Common Color Mask - 12

Un outil à part entière. Il permet de régler l'aspect de l'image (chrominance, luminance, contraste) et sa texture en fonction de la portée (Scope).

Soft Light & Original Retinex - 7

Applique un mélange de lumière douce (identique à l'ajustement global). Effectue un "dodge and burn" en utilisant l'algorithme Retinex original.

Blur/Grain & Denoise - 1

Peut être utilisé pour flouter les arrière-plans, adoucir la peau, ajouter du grain de film et débruiter

Tone Mapping - 2

Identique à l'outil de Tone mapping du menu principal. L'outil du menu principal doit être désactivé si cet outil est utilisé .

Dehaze & Retinex - 3

Dehaze et Retinex (mode avancé uniquement). Utile pour retirer la brume, le contraste local avec des valeurs élevées et la simulation de la "clarté" (clarity).

Sharpening - 8

Utilise RL deconvolution sharpening. Visualiser à 1:1

Local Contrast & Wavelets - 8

Contraste local : essentiellement les mêmes fonctions que le Contraste local de l'onglet Détails. Ondelettes : basé sur Niveaux d'ondelettes (wavelet) dans l'onglet Avancé, avec essentiellement les mêmes fonctions (clarté, contraste, flou, etc., voir la documentation). Des fonctions supplémentaires telles que le filtre gradué (Graduated Filter), Tone mapping, etc. ont également été incluses. Son utilisation dans les Réglages locaux offre des possibilités supplémentaires telles que l'élimination de gros défauts, de taches de graisse, etc.

Contrast By Detail Levels - 4

Contrast by detail levels :Peut être utilisé pour éliminer les marques du capteur (graisse,..) ou de l'objectif.

Color appearance(Cam16 & Jzcz) - 12

Ce module est une version simplifiée du module Color Appearance & Lighting(Ciecam02/16) de l'onglet Avancé du menu principal, qui a été adapté aux exigences spécifiques des réglages locaux. Il a également été étendu pour prendre en compte le pic de luminance HDR et inclut une fonction expérimentale JzCzHz (en mode Avancé) pour améliorer le traitement HDR.

Chaque module d'outil peut être basculé entre les modes de complexité: basic, standard et advanced. Le mode par défaut peut être défini dans la fenêtre Préférences de RawTherapee.

Comment démarrer - premiers pas

Les exemples qui suivent sont conçus pour donner un aperçu de certaines des façons dont les différents outils peuvent être utilisés pour les ajustements locaux. Toutefois, si vous préférez explorer les possibilités par vous-même, essayez de régler la "complexité par défaut des ajustements locaux" dans le module Préférences sur Basic et décochez la case "Afficher les paramètres supplémentaires" en haut du module Ajustements locaux. Vous obtiendrez ainsi une version simplifiée mais puissante des ajustements locaux.

De mon point de vue, Basic est le mode qui correspond le mieux (absence de masques et généralement de courbes) à mon intention initiale en 2015.

Pour commencer, explorez les capacités des outils "Color & Light", "Shadows/Highlights & Tone Equalizer" et " Vibrance & Warm/Cool " et n'hésitez pas à essayer les fonctionnalités supplémentaires en réglant manuellement le mode de complexité sur Standard (dans la boîte combo du module sur lequel vous travaillez).

L'outil Color & Light est extrêmement puissant et comprend des fonctions du module "Coor Toning > Color corrections Région" dans l'onglet Couleur du menu principal ainsi que les courbes L*a*b* disponibles dans l'onglet Exposition. Remarque : les captures d'écran des exemples suivants sont actuellement mises à jour pour tenir compte des derniers développements. De ce fait, certains noms de curseurs et de modules seront différents du texte.

Premiers pas

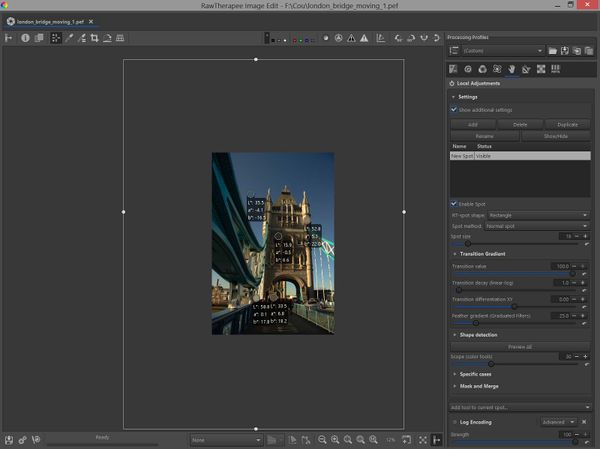

Démarrage

- Dans la barre des onglets, sélectionnez la "main" (Onglet Local)

- Puis activez "expander" "Local Adjustments" (si il n'est pas déjà activé)

- Sélectionnez "Add"

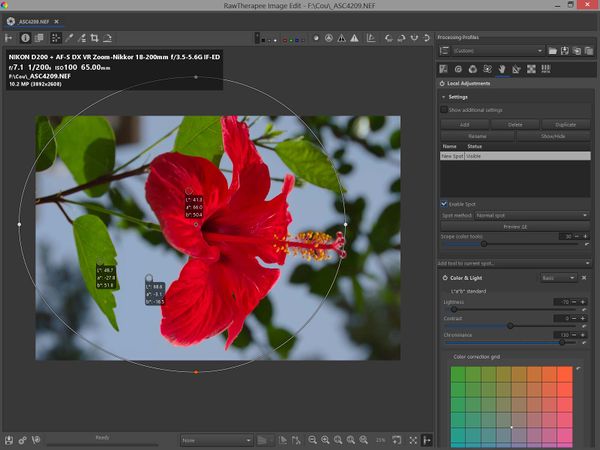

Fichier raw (Jacques Desmis - Creative Common Attribution-share Alike 4.0): [1]

Préparation

Positionnez le RT-spot à l'endroit souhaité. Dans ce cas, je souhaite accroître la saturation de la fleur rouge et réduire la luminance (lightness) sans affecter le reste de l'image:

- déplacez le centre du RT-spot de telle manière que son centre soit situé sur une zone représentative de ce que vous souhaitez changer.

- positionnez les 4 délimiteurs largement au delà de la fleur.

- sélectionnez le "Lockable color picker" et repérez 3 couleurs : a) une sur la fleur rouge, b) une sur le ciel bleu, c) une sur une feuille verte

- Dans l'exemple les 3 couleurs sont:

- fleur rouge L=48.6 a=74.4 b=47.0

- ciel bleu : L=68.6 a=-3.1 b=-16.6

- feuille verte : L=48.3 a=-28.3 b=51.4

Ajouter l'outil Color & Light

Voir dans "Quelques particularités du mode local (par rapport à Lab adjustments)": Particularités Color & Light

Dans le menu settings, choisissez "Add tool to current spot..."

- une liste de choix vous est proposée : "Color&light 11",..., "Log Encoding 0". Pour chaque RT-spot vous pouvez associer 1 ou plusieurs outils de la liste. L'ordre de traitement dans le processus correspond au numéro à la fin du choix : "Encoding Log - 0" est le premier traitement (si bien sûr il est activé), "Color&light(defects) -11" est le dernier. Ceci est également vrai pour les masques associés.

- sélectionnez "Color & Light (Defects) - 11"

Réglez la luminance (lightness) et la chrominance

- réglez la luminance sur -70

- réglez la chrominance sur 130

- Examinez les résultats

- la fleur rouge a une nouvelle couleur L=41.3 a=66.0 b=50.4

- le ciel est inchangé

- la feuille verte est inchangée

Essayez Scope Color Tools - Transition

Dans le menu "settings"

- Agissez sur "Scope Color Tools"

- si vous réduisez la valeur (par défaut 30) seule une partie des rouges sera concernée.

- si vous accroissez la valeur, progressivement le ciel, puis la feuille verte, puis toute l'image sera concernée (Scope=100)

Laissez la valeur Scope à 100 et dans le menu "settings"

- Agissez sur transition:

- essayez de réduire vers 5

- essayez d’accroître vers 100 et constatez le résultat

Prévisualisez la zone modifiable - deltaE - ΔE

Vous pouvez avoir un aperçu des zones de l'image qui seront touchées par les modifications - cela ne montre pas les modifications, ni les transitions, mais permet de régler "Scope". Deux possibilités:

- utiliser le bouton "Preview ΔE" situé dans "settings" et un et seulement un, outil doit être activé (expander)

- utiliser dans "Mask and modifications" - "Preview deltaE" - dans ce cas le GUI prend en compte l'état des outils - cette option fonctionne quelque soit le nombre d'outils activés.

Vous pouvez faire varier l'intensité et la couleur de cette prévisualisation avec "ΔE preview color - Intensity" Vous pouvez aussi voir l'action des divers réglages possibles relatif à la détection de forme : essayez les curseurs de "Shape detection" à l'exception de Threshold structure.

Voir les modifications

Vous pouvez avoir un aperçu des modifications que vous avez réalisées:

- Allez à "Mask and modifications" - "Show modifications without mask"

- vous pouvez visualiser les incidences de la luminance, du contraste, des changements de couleurs et saturation, structures,...

- vous pouvez aussi visualiser l'incidence des réglages de la transition (settings) :

- transition value : pourcentage géographique entre pleine action et action décroissante (jusque zéro)

- transition decay (linear-log) : "vitesse" d'affaiblissement de la zone d'action décroissante

- transition différentiation XY : différence entre abscisse et ordonnée

Essayez ici tous les réglages:

- ceux de Scope (deltaE)

- ceux des transitions

- les réglages de l'outil (luminance, chroma, etc.)

Travailler en Image entière et utiliser "excluding" spot

Local adjustments ne se limite pas aux retouches locales. Vous pouvez profiter des ressources de ce module pour traiter l'image entière. Actuellement ce mode est "manuel", une automatisation du GUI est prévue...

Choisissez dans "settings" :

- Shape RT-spot area = rectangle

- positionnez les 4 délimiteurs en dehors de la prévisualisation (preview)

- réglez la transition sur 100 (ou une autre valeur si vous le souhaitez... pour générer un gradient), mais il y a d'autres outils pour réaliser des gradients!

Vous êtes prêts maintenant pour utiliser l'ensemble des outils en mode pleine image

Combinaison d'outils avec un seul RT-spot

La plupart des outils d'ajustement local peuvent être utilisés ensemble dans le même RT-Spot. Cependant, les combinaisons de Log Encoding, Tone Mapping et Retinex doivent être évitées. En effet, le fichier de sortie TIFF ou JPG peut ne pas correspondre à l'aperçu, en particulier lorsque celui-ci a été agrandi à l'aide de la fonction zoom.

L'association de l'un des outils ci-dessus avec les autres outils d'ajustement local, tels que Color & Light, ne pose pas de problème.

Si vous souhaitez utiliser des combinaisons des 3 outils mentionnés ci-dessus, vous pouvez simplement ajouter un autre RT-Spot à proximité du premier.

Par exemple, le premier RT-Spot pourrait être consacré à Log Encoding, et le second à la cartographie des tons ou au Retinex. D'autres outils peuvent être ajoutés à l'un ou l'autre des deux points RT selon les besoins.

Exemples concrets

Changer la couleur des feuilles vertes - sauf une

Changer le couleur des feuilles

- L'utilisation des composantes "a" et "b" de "Lab" dans "Color grid correction", en choisissant "direct" et une valeur élevée de "Strength", amène un changement de couleur de toutes les feuilles.

- Vous pouvez adapter si nécessaire avec "Scope color tools"

- Les autres couleurs : fleur, ciel ne sont pas modifiées

[[File:colorleav1.jpg|600px|thumb|center|Changer la couleur des feuilles]

Une des feuilles redevient verte

- Ajouter un deuxième RT-spot (add)

- choisir Spot Method = Excluding Spot

- déplacer le RT-spot vers la feuille à conserver - encadrer largement

- agir sur "Scope excluding" (settings) jusqu'à obtenir l'effet désiré

- vous pouvez utiliser le "Excluding spot" comme un RT-spot normal et si nécessaire utiliser tous les outils disponibles notamment Denoise, Blur, etc.

Traiter les yeux rouges - retirer les défauts du capteur

Voir dans "Cas d'usage spécifique : réduction des défauts": Réduction des défauts

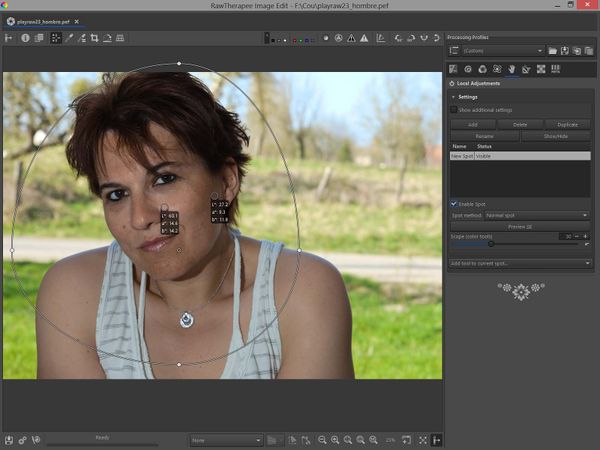

Traiter les yeux rouges - 3 étapes : préparation, régler le RT-spot, supprimer le rouge

Préparation

- Choisissez une sélection large autour de l’œil

- mettez le RT-spot sur la zone rouge de l’œil (pupille)

- mettez 4 "Lockable color pickers" pour repérer les changements

Régler le RT-spot

- Ajoutez l'outil "Color & light"

- Pressez le bouton dans "Settings" "Preview deltaE"

- Réglez le RT-spot pour obtenir l'effet désiré au niveau de la sélection

- Ici j'ai choisi de réduire la taille du centre (Spot size) = 14

- Scope color tools = 18

Supprimer le rouge

- dans l'outil "Color & light", réduisez la chrominance à -100

- examinez le résultat :

- la pupille de l’œil n'a quasiment plus de dominante de couleur

- l'iris, la cornée et la peau du visage sont inchangés

- vous pouvez être amenés selon les cas, à changer les valeurs des "transitions" (plus faibles) et "transition decay" plus élevée

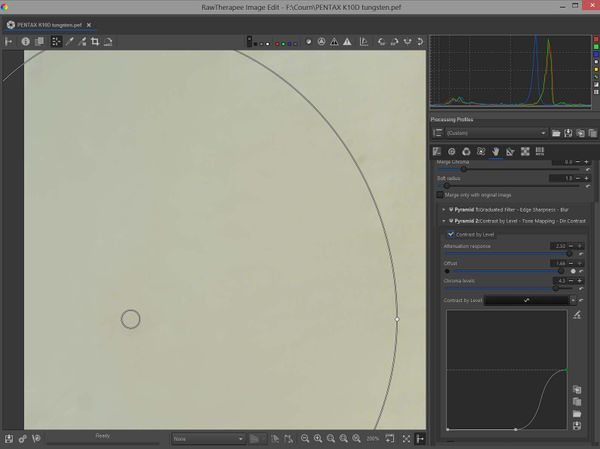

Même démarche pour retirer les défauts de capteur ou les taches

Vous pouvez utiliser le même principe pour retirer les petits défauts de capteur, mais avec d'autres outils

- soit avec Contrast By Detail Levels)

- soit avec Wavelet pyramid2 - Contrast by levels

- dans les 2 cas, réduisez le contraste pour les bas niveaux de décomposition

- agissez éventuellement sur Blur levels (wavelet pyramid1)

- Utilisez de faibles valeurs de "transition" (moins de 20) et d'importantes valeurs de "transition decay" (plus de 15)

- la taille minimale du RT-spot dans ces 2 cas est de 32x32 - ce qui n'a que peu d'incidences

Un exemple - retirer de nombreuses taches avec wavelet pyramid2

- constat

- une solution possible

- activez l'outil "local contrast - wavelets"

- choisissez "advanced", puis "wavelet"

- réglez scope vers 20

- allez dans Pyramid2 et activez "Contrast by level"

- réglez avec des valeurs élevées de "Attenuation Response", "Offset", "Chroma levels" (si nécessaire)

- activez la courbe "Contrast by level" en réduisant le contraste pour les faibles niveaux.

Comment réaliser un Dodge and burn (Éclaircir et brûler)

Voir dans "Quelques particularités du mode local (par rapport à Lab adjustments)": Original Retinex

Dans beaucoup de portraits, ou de photos où la peau est exposée à la lumière, il se produit un phénomène peu agréable d'accroissement de contraste, certaines parties de la peau sont légèrement surexposées, alors que d'autres sont légèrement sous exposées.

- traditionnellement ce problème est traité avec des masques et des calques - il est existe de nombreux tutoriels avec Photoshop (C). Vous pouvez aussi probablement le traiter avec les masques incorporés dans RT "Local adjustments"

- d'autres techniques permettent un traitement localisé avec des brosses, faisant ou non appel à des processus automatiques de traitement.

- ce que je propose ici est tout autre, il s'agit d'utiliser le concept de "Original Retinex" (Provient de la recherche Ipol) - ce pourquoi a été élaboré Retinex dans les années 1970 et non l'usage qui en a été fait ailleurs - y compris ici dans Rawtherapee:

- utiliser un ou plusieurs Laplaciens à seuil réglable

- résoudre l'équation de Poisson (PDE - Équation aux dérivées partielles)

- équilibrer les luminances.

Je ferais la démonstration en 3 étapes : préparation, réglages du Laplacien et aperçu des modifications, résultat

Préparation

- Je ne reprendrais pas les étapes de réglage du deltaE (attention à utiliser le Scope de Original Retinex), ni des transitions, les principes sont identiques aux exemples précédents

- j'ai choisi un portrait, mais par souci de confidentialité j'ai masqué les yeux.

- choisir "Add tool to current spot..." : "Soft Light - Original Retinex" - "Advanced" - "Original Retinex"

Réglages du Laplacien et aperçu des modifications

- Agir sur le curseur : Strength (qui prend en compte le seuil du premier Laplacien)

- Agir sur le curseur : Laplacian threshold deltaE (qui prend en compte le deltaE de l'image pour agir sur un deuxième Laplacien). Ce traitement est en amont des algorithmes Scope - et peut prendre en compte les différences dans les arrières plans...

- Visualiser les modifications en choisissant: "Show process Fourier" : "show modifications without mask"

Résultats

Un algorithme similaire est utilisé dans "Exposure" - Laplacian PDE IPOL Contrast attenuator" - il permet de traiter des images avec d'importants écarts d'exposition, souvent globalement sous-exposées.

Réaliser un "Graduated Filter" Luminance - Chrominance et Teinte (filtre dégradé)

A voir dans Principes généraux Graduated Filter Luminance Chrominance Teinte

Toujours à titre de démonstration, je vais utiliser les possibilités de réaliser un Filtre dégradé à la fois pour la luminance, la chrominance et le teinte (hue).

Préparation

- je choisis l'image qui a servi au démarrage

- Je repère 7 points avec un "Lockable color picker"

- Add tool to current spot..." - "Color & Light" - "Advanced"

Fichier raw (Creative Common Attribution-share Alike 4.0): [2]

Réaliser un "Graduated Filter"

Arbitrairement je choisis les réglages suivants

- Gradient strength luminance : -0.44

- Gradient strength Chrominance : -1.13

- Gradient strength Hue : 2.69

- Gradient angle : -87.6

- Scope color tools = 30

- Feather gradient(settings) = 25

Changer les réglages par défaut

- Essayez de changer progressivement "Scope color Tools", portez le à 70, 75, 80, 85, 90, 100

- Changez "Feather" et notez les variations

- Bien sûr vous pouvez aussi changer les valeurs des gradients (L, C, H, angle)

- et aussi si vous le souhaitez les valeurs de "Color and light"

Cinq manières de changer l'exposition - relever les ombres - Évaluer la Dynamique Range - DR

Voir dans: Quelques particularités du mode local (par rapport à Lab adjustements)- Shadows/Hightligt & Tone Equalizer Shadows/Highlights & Tone Equalizer

Cette démonstration est uniquement à caractère pédagogique, pour montrer les diverses possibilités (non exhaustives) en matière de traitement de l'exposition. Mes choix sont arbitraires.

- J'ai choisi de le faire avec une image difficile, ombre accentuées avec au centre une zone proche des limites d'exposition.

- Cinq méthodes sont juste "montrées" avec des réglages arbitraires

- Shadows/Highlight

- Tone Equalizer

- TRC (Tone Response Curve)

- Log Encoding

- Exposure (Dynamic Range & Exposure)

J'aurais pu aussi utiliser :

- des courbes de contraste,

- ou relever les ombres avec "Lightness" (Color & Light)

- ou utiliser un Graduated Filter Luminance

- ...

Préparation

- par défaut j'ai réglé Scope à 50 ("Scope color tools" pour Shadows/Highlight", mais aussi Scope pour Log Encodinh, Scope pour Exposure)

- Essayez de faire varier cette valeur de 20 à 100

Fichier raw (Rawtherapee - Creative Common Attribution-share Alike 4.0): [3]

Utiliser Shadows/Highlights

Add tool to current spot..."Shadows/Highlights & Tone Equalizer"

- Shadows/Highlight

- essayez de changer "Shadows tonal width"...et "Highlight"

Utiliser Tone Equalizer

Add tool to current spot..."Shadows/Highlight & Tone Equalizer"

- Tone Equalizer

- essayez les curseurs 2, 3 et 4

Utiliser TRC

Add tool to current spot..."Shadows/Highlight & Tone Equalizer" au moins en mode "Standard"

- TRC

- augmentez "slope" jusque 150....revenez à 60

- essayez de diminuer gamma et de l'accroître

Utiliser Log Encoding

Add tool to current spot..."Log Encoding"

- Attention le "scope" à utiliser est celui de "Log encoding" : scope = 50

- cliquez sur le bouton "Automatic"

- agissez sur "Target grey point"

Utiliser Exposure

Add tool to current spot... "Dynamic Range & Exposure"

- Choisissez "standard"

- Réglez "Exposure compensation ƒ" (un Laplacien et une transformée de Fouriers sont appliqués en amont de Exposure)

- j'ai réglé des curseurs de "Tools exposure" : black à -1500, shadows à 50

- par défaut "Highlight compression" est à 20, faites varier

- essayez en neutralisant ces réglages

- essayez d'autres réglages de "Tools exposure"

Recommandations

Pour les portraits et les images à faible gradient de couleurs:

- utiliser "Exposure" avec précautions, dans ce cas des portraits (skin), ainsi que ceux avec une faible variation de couleurs, l'algorithme proche de celui de "exposure compensation main" est peu approprié, il vient d'être amélioré (5 juillet 2020) par l'ajout d'un Laplacien pour résoudre les différences de contraste.

Malgré les améliorations et d'une manière générale:

- l'algorithme "Exposure" est peu performant, mais les utilisateurs ont l'habitude de l'utiliser. J'ai été amené à mettre en place des palliatifs pour le rendre convenable;

- lui préférer (solutions les plus simples):

- Tone Equalizer - dans Shadows/Highlight & Tone Equalizer

- Tone Response Curve (TRC) - lui aussi dans dans Shadows/Highlight & Tone Equalizer (Equalizer en mode "Standard"). N'hésitez pas à accroître "Slope" pour déboucher linéairement les ombres. Vous pouvez agir sur le gamma pour éclaircir les zone claires.

Si néanmoins vous souhaitez utiliser "exposure",je recommande - non obligatoire - de changer dans "settings" les paramètres de "Shape detection"

- accroître "Threshold ΔE scope"

- réduire "ΔE decay"

- régler "Balance ΔE ab-L" vers L

- adapter Scope si nécessaire

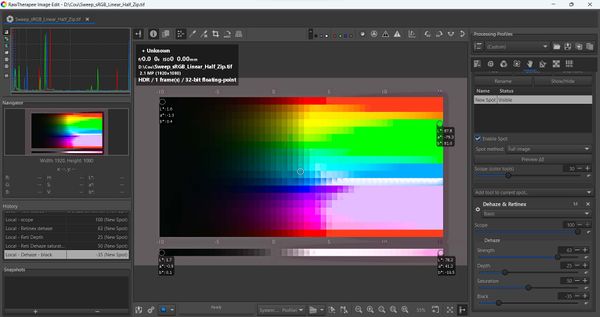

Évaluer la Dynamic Range des outils en termes de Dynamic Range (DR)

Fichier TIF (Creative Common Attribution-share Alike 4.0): [4]

Image d'origine - 25Ev - sans traitement

Remarquez :

- les ombres sont bouchées

- 40% environ de l'image est avec des blancs à 100%

- la DR noir et blanc restituée est d'environ 12 à 13 Ev

Image avec Local Adjustments - Log encoding

Remarquez :

- les ombres et les lumières occupent toute la plage visible de L=1 à L=99.8 (échelle 0 - 100)

- les couleurs semblent uniformément réparties selon la luminance. L*a*b* ne pénalise pas la Dynamic Range (DR)

- la DR couleur et noir et blanc restituée est de 25Ev

- Noter l'utilisation de "White distribution = 90"

Image avec Local Adjustments - Color Appearance - Cam16

Remarquez :

- les ombres et les lumières occupent une partie de la plage visible de L=1 à L=80.9 (échelle 0 - 100)

- les couleurs semblent uniformément réparties selon la luminance. L*a*b* ne pénalise pas la Dynamic Range (DR)

- la DR couleur et noir et blanc restituée est de 25Ev

- Noter l'utilisation de "White distribution = 100" et "Black distribution = 60".

A noter la différence avec Log encoding, qui est due à l'action de Ciecam et change la répartition des lumières.

- Agir sur le gamma de la TRC restitue sensiblement l'image Log Encoding ci-dessus.

- Ou agir sur Contrast J et Luminance J restitue sensiblement l'image Log Encoding ci-dessus.

Image avec Local Adjustments - Tone Equalizer

Remarquez :

- les ombres et les lumières occupent une partie de la plage visible de L=1 à L=82 (échelle 0 - 100)

- les couleurs ne semblent pas uniformément réparties selon la luminance. L*a*b*, la Dynamic Range est un peu pénalisée

- la DR noir et blanc et couleur restituée est sensiblement de 15Ev à 18Ev

- Noter l'utilisation de un cinquième slider pour traiter les très hautes lumières : 5(lightest) = -100

Image avec Local Adjustments - Dynamic Range & Exposure

Remarquez :

- les ombres et les lumières occupent une partie de la plage visible de L=4 à L=95.8 (échelle 0 - 100)

- les couleurs ne semblent pas uniformément réparties selon la luminance et selon les couleurs (dérive de couleurs dans les bleus). L*a*b*, la Dynamic Range est un peu pénalisée

- la DR noir et blanc et couleur restituée est sensiblement de 17Ev à 20Ev

- notez la complexité et le peu d'intuitivité des actions et le temps de traitement important

Image avec Local Adjustments - Dehaze

Remarquez :

- les ombres et les lumières occupent une partie de la plage visible de L=1 à L=88 (échelle 0 - 100), les ombres sont peu débouchées

- les couleurs ne semblent pas uniformément réparties selon la luminance. L*a*b*, la Dynamic Range est pénalisée

- la DR noir et blanc et couleur restituée est sensiblement de 15Ev à 16Ev

Image avec Local Adjustments - Shadows/Highlights

Remarquez :

- les ombres et les lumières occupent une partie de la plage visible de L=1 à L=70 (échelle 0 - 100)

- les couleurs ne semblent pas uniformément réparties selon la luminance. L*a*b*, la Dynamic Range est pénalisée

- la DR noir et blanc et couleur restituée est sensiblement de 12Ev à 14Ev

Image avec Local Adjustments - Tone Response Curve - TRC

Remarquez :

- les ombres et les lumières occupent une partie de la plage visible de L=1 à L=95.6 (échelle 0 - 100)

- les couleurs ne semblent pas uniformément réparties selon la luminance. L*a*b*, la Dynamic Range est un peu pénalisée

- la DR noir et blanc et couleur restituée est sensiblement de 12Ev à 16Ev

Image avec Local Adjustments - Dynamic Range & Exposure : Exposure only

Remarquez :

- les ombres et les lumières occupent une partie de la plage visible de L=1 à L=70.9 (échelle 0 - 100)

- les couleurs ne semblent pas fidèles, ni uniformément réparties selon la luminance. L*a*b*, la Dynamic Range est très pénalisée

- la DR noir et blanc et couleur restituée est sensiblement de 11Ev à 14Ev

Image avec Local Adjustments - Tone Mapping

Remarquez :

- les ombres et les lumières occupent une partie de la plage visible de L=1 à L=72.4 (échelle 0 - 100)

- les couleurs ne semblent pas uniformément réparties selon la luminance. L*a*b*, la Dynamic Range est très pénalisée

- la DR noir et blanc et couleur restituée est sensiblement de 10Ev à 14Ev

Synthèse

- Les outils utilisant l'algorithme "Log encoding" - comme "LA Log encoding" ou "LA Color-Appearance Cam16" ont une restitution maximale et totale des couleurs et de la dynamic range (DR), mais leur utilisation n'est pas intuitive.

- "LA Tone Equalizer" assure une assez bonne restitution pour cette image. L'outil doit convenir pour une majorité d'images issues d'appareils photos. Il est intuitif mais nécessite au moins 5 réglages.

- "LA Dynamic Range & Exposure" a une restitution de la DR très bonne, certaines couleurs subissent des dérives. Les réglages sont peu intuitifs, le système est lent.

- "LA TRC" assure une restitution moyenne pour cette image. L'outil doit convenir pour beaucoup d'images issues d'appareils photos. L'utilisation est simple et intuitive.

- "LA Dehaze" peut être apporter un traitement significatif de la DR, si il est utilisé par ailleurs, par exemple pour ce qu'il est conçu, le traitement de la brume.

- Les autres outils, "LA Exposure", "LA Shadows/Highlights" ne sont que de peu d'intérêt pour la DR.

- Curieusement 1 outils "dédié" (en théorie) à la DR - "LA Tone Mapping" n'a pas de bons résultats.

Traitement d'une image brumeuse

Quelques explications dans "Quelques questions" : Association Retinex - Dehaze

Je prendrais l'exemple d'une image très brumeuse et appliquerais en première étape le traitement "Dehaze" du main menu Puis je continuerais le traitement avec un complément pour le ciel et l'horizon, avec Retinex local

Image originale

Fichier raw (Pixls.us - Common Attribution-share Alike 4.0): [5]

Traitement avec Dehaze (main)

J'aurais pu le faire avec "dehaze local" (Dehaze & Retinex) ...et un RT-spot! Mais examinez l’arrière plan, les collines...il reste beaucoup de brume

Complément avec Retinex local

- Choisir "add tools to current spot.." : Dehaze - Retinex - "advanced"

- Essayer plusieurs réglages par itérations successives

- agissez si nécessaire avec la courbe "transmission map"...avec un affaiblissement de la courbe à droite...

- examinez maintenant les collines et le ciel à l'horizon !

Comment utiliser le module "Denoise"

Voir dans "Quelques particularités du mode local (par rapport à Lab adjustements) Denoise

Plusieurs utilisations sont possibles.

- en complément sur certaines zones du module "denoise main", dans ce cas les réglages de "denoise main" seront réalisés a minima

- en traitant toute l'image en mode "local adjustments" - "Denoise" et en excluant une zone avec "excluding"

- pris isolément pour réduire le bruit dans des images peu bruitées - par exemple pour retirer le bruit d'un ciel, ou d'un visage

- pris isolément pour traiter le bruit dans une zone choisie et en le laissant volontairement dans le reste de l'image, à des fins artistiques

C'est ce dernier cas que je vais expliciter.

L'image de la jeune fille est particulièrement bruitée avec un fort bruit chromatique

Fichier raw (Copyright Ian Burley - Common Attribution-share Alike 4.0): [6]

Zoom 100%

Quels réglages pour denoise ?

- la position du spot, sa taille ont de l'importance : j'ai choisi une zone du visage avec un fort bruit chromatique et un assez gros RT-spot "spot size"

- le choix de scope est important : dans ce cas - où le bruit occupe quasiment tout le spectre coloré (rouge, vert, bleu, jaune) il faut choisir une valeur élevée de scope (ici 90). Si, avec une autre image, le traitement du bruit concernait uniquement la luminance il faudrait choisir la valeur de scope "habituelle", soit aux environs de 30, pour permettre à l'algorithme de différencier l'action selon les couleurs.

- par rapport à "denoise main" plusieurs changements:

- possibilité de régler le débruitage luminance en fonction du niveau de détail (de 0 à 6 selon la position sur l'abscisse de la courbe), à l'aide d'une courbe

- une différentiation est faite en fonction du niveau de détail : si les niveaux 3 et au-dessus sont supérieurs à 20% de l'ordonnée de la courbe, il en résultera une action plus destructive sur la luminance.

- la différenciation "sombre - clair" pour la luminance est traitée par un "equalizer", plutôt que par "gamma"

- possibilité de différencier l'action entre "chroma fine" (bruit d'impulsion, bruit faible de chrominance...niveaux de 0 à 4) et "chroma coarse" (paquets, bloatches..niveaux 5 et 6)

- l'algorithme "chroma" utilise une action plus destructive, si le curseur "coarse" est supérieur à 20.

- un "equalizer" "rouge vert" / "bleu jaune" peut être utile pour les images faiblement bruitées

- ajout d'un curseur "chroma detail recovery" - utilisant DCT (discrete cosinus transform : Fourier)

- ajout d'un curseur "Detail threshold luminance Chroma (DCT)" qui permet de différencier l'action en fonction des bords ("edge detection")

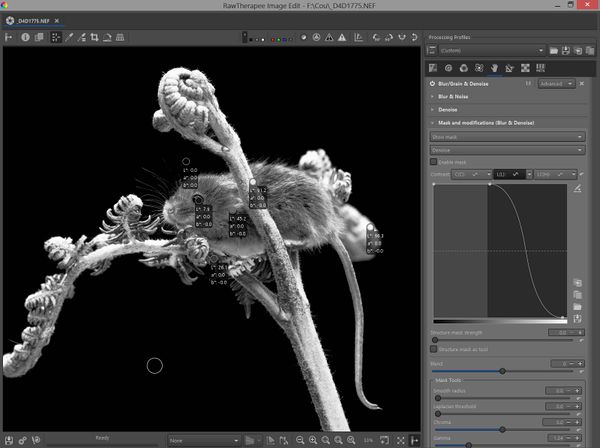

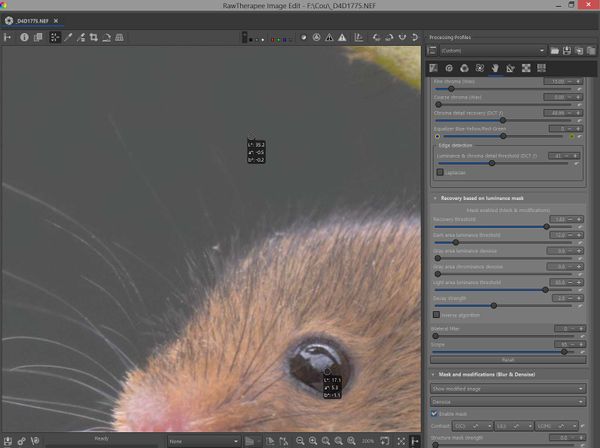

Un cas complexe "Denoise" - comment différentier l'action sur les structures et les aplats

Ce cas, habituel en photographie, consiste à isoler un sujet sur un fond. Le sujet pouvant être un animal, une plante, une personne,... Le fond peut être le ciel, une pelouse, une forêt, un mur... Le problème à traiter par les logiciels de dé-bruitage est complexe, car l'algorithme le plus souvent "ignore" la différence "sujet", "fond" et aboutit si on souhaite supprimer le bruit sur le "fond" à perdre toute les reliefs, contrastes et couleurs du "sujet"

Un exemple le "mulot"

J'ai choisi cette image, avec l'accord de son auteur Andy Astbury, car d'une part elle est excellente, l'animal se détache très bien sur un fond d'apparence gris, et d'autre part elle est bruitée (légèrement). Si on souhaite retirer le bruit sur le fond, avec "Noise reduction" (main), le "mulot" perd contraste et saturation et détails.

Fichier raw :(Copyright Andy Astbury - Creative Common Attribution-share Alike 4.0) [7]

Fichier pp3 [https://drive.google.com/file/d/1qwslSsbXlM4Ns8A_2t_8_QSMWfsIuAR8/view?usp=sharing Le fichier pp3 ne donne pas "le bon réglage" mais garde la trace de réglages de certains outils pour faciliter la découverte des méthodes et outils.

Traditionnellement dans Rawtherapee, on utilise pour retirer le bruit, le module "Noise reduction" (onglet détail). Si on a pour objectif de rendre l'arrière plan sans bruit de luminance et de chrominance - je ne montre pas l'image ni les réglages - on aboutit a des réglages de l'ordre de:

- curseur luminance = 65

- curseur chrominance - Master = 20

Certes le fond d'image sera parfait, mais notre gentil "mulot" va devenir terne, lavé... Alors comment faire ?

Principe de la démarche:

- traiter le bruit en 2 étapes - une première a minima utilisant "noise reduction" va permettre de traiter le bruit sur le sujet qu'on souhaite préserver (ici le "mulot"); dans le cas présent l'œil du "mulot" sera discriminant, ainsi également par exemple que la queue. A noter que dans d'autres images cette étape pourra permettre aussi de réduire les gros paquets de bruit.

- mais le bruit s'apparente aux principes des modèles d'apparence colorée; il sera nettement plus visible sur un fond gris que sur un fond plus sombre (notamment le bruit de chrominance), il en est de même pour les parties lumineuses. On a donc intérêt à coupler dans la même démarche un ajustement des tons de l'image - qui peut également la rendre plus attractive - et le dé-bruitage.

- ensuite, en deuxième étape, nous traiterons le bruit avec "Local adjustments", en utilisant les capacités de cet outil, notamment, les 5 méthodes ci-dessous:

- le masque qui va permettre de différencier l'action entre les reliefs ("mulot", "végétation"...) et le "fond".

- l'égalisateur Hue qui va permettre de différencier l'action entre la couleur du "mulot" et le "fond"

- le curseur Scope (deltaE) qui permet de différencier l'action selon les différences de couleurs

- les curseurs "luminance detail recovery (DCT) - et dans "edge detection" - luminance et chroma detail theshold, qui agissent par un traitement du bruit (Fourier) basé sur le bruit résultant de l'écart entre l'image originale et celle débruitée par les wavelets.

- le débruitage par morceaux - encore appelé "Non local Means", un autre algorithme de débruitage, fondé sur la similarité de pixels et de patch - va lui aussi permettre de différencier l'action entre les reliefs ("mulot", "végétation"...) et le "fond".

- puis nous ferons des ajustements terminaux pour obtenir l'image souhaitée - saturation, contraste local, etc.

- bien sûr ce document est à titre pédagogique, les réglages sont arbitraires plus tournés vers l'exemple que la recherche d'une belle image.

Premier "denoise" et "égalisateur de tons"

Sur cette image apparaît seulement l'égalisateur de tons. On agira en même temps sur "Noise reduction" - luminance et chrominance.

On positionnera des "lockable color pickers" sur l'œil, la fourrure, la végétation, la queue.

- ajouter un nouveau "RT spot" - choisir dans settings "Full image". Toujours dans settings aller à "Mask and merge" et régler "background color for luminance and color masks" à 0 (ceci va permettre un meilleur suivi des valeurs de la luminance)

- Add tool to current spot..: choisir "shadows/highlight and Tone equalizer" - Basic

- positionner le centre du "RT-spot" sur le "fond"

- agir sur les curseurs de l'égalisateur pour obtenir le meilleur compromis, tout en agissant sur les 2 curseurs de "Noise reduction" - ici j'ai utilisé - Luminance = 4 - chrominance = 6.5

Deuxième étape - Local adjustments - Blur/grain & Denoise module

- Add tool to current spot... Sélectionnez "Blur/grain & Denoise", puis "Denoise", "Avancé"

- Utiliser la courbe "Luminance detail by level"

- à titre pédagogique et afin de voir l'efficacité des divers outils vous pouvez mettre cette courbe au maximum et activer "agressive"...bien sûr il faudra ensuite la ramener à des valeurs normales.

Puis, je recommande, toujours à titre pédagogique d'essayer une par une, les 5 méthodes citées plus haut. Par exemple pour voir l'action de l'égalisateur Hue, mettre Scope à 100, mettre le curseur "Recovery threshold à 1" dans "Recovery based on luminance mask" pour le désactiver, laisser les 3 curseurs DCT à leurs valeurs par défaut.

- régler le Equalizer hue en renforçant le débruitage pour le "fond" et en l'atténuant pour le "mulot"

- agir légèrement sur "Fine chroma"

- examinez les résultats

- Réaliser un masque.

- Ce masque va permettre ensuite avec un des outils de "Local adjustments - denoise", de discriminer l'action entre le "fond" et le reste de l'image "mulot" et végétation.

- Dans le cas présent je me suis servi d'une simple courbe L(L), du gamma et de la courbe de contraste , mais d'autres images pourraient nécessiter d'utiliser la courbe LC(H), structure mask strength, Smooth radius, etc.

Courbe de contraste:

Ensuite:

- activez le masque (mask and modifications)

- ouvrez l'expander "Recovery based on luminance mask"

- agissez sur "Recover threshold", des détails vont réapparaître...

Pour d'autres images il sera peut être nécessaire d'agir sur :

- "Dark area luminance threshold", valeurs en-dessous de laquelle la luminance du masque sera prise en compte pour accroître le dé-bruitage - la référence du noir étant celle du masque

- "Light area luminance threshold", valeurs au-dessus de laquelle la luminance du masque sera prise en compte pour accroître le dé-bruitage de manière régressive - la référence du blanc étant celle du masque si elle existe correspondra au dé-bruitage maximum- de cette référence jusqu'au blanc maximum qui si il est à 100 n'aura pas de dé-bruitage. Cette action va ici permettre par exemple de "dé-bruiter" ou non les parties claires de la végétation.

- decay permet de gérer la progressivité des changements

- les 2 curseurs "Gray area" permettent si nécessaire de réintroduire un débruitage dans la zone "protégée" - tons moyens du masque

- Utilisation de Scope : ici nous sommes en terrain connu. Vous pouvez utiliser dans "Mask and modifications" les 2 sélections "Show modified areas with mask" et "Show modified areas whithout mask" pour voir l'incidence de Scope...Ou plus simplement agir sur Scope et voir l'effet. Sur cette image, avec "Equalizer hue" désactivé et "Recovery based on luminance mask" à 0, l'action de Scope est sensible entre 50 et 100.

- Utilisation des 2 curseurs "Luminance detail recovery" et "Luminance & chroma detail threshold"

- accroissez progressivement "Luminance detail recovery"

- agissez en parallèle sur le "Luminance & chroma detail threshold"... vous verrez réapparaître des détails.

- 2 algorihmes sont possibles - le premier utilise un masque interne - le second un Laplacien. Chacun a ses particularités, le Laplacien est plus sélectif, mais moins progressif

- Utiliser "Débruitage par morceaux (patch)" (Non-local means)

- Débruitage par morceaux - c'est quoi ? Contrairement aux filtres habituels qui réalisent une moyenne des valeurs du groupe de pixels localisés autour d'un pixel cible afin de réduire le bruit, le filtre "non-local means" réalise une moyenne de la totalité des valeurs des pixels contenus dans l'image, pondérées en fonction de leur similarité avec le pixel cible. Le résultat d'un tel filtrage permet d’amoindrir la perte de détails au sein de l'image, comparé aux filtres réalisant des moyennes localement.

Afin de bien percevoir les effets de cette méthode, je recommande toujours à titre pédagogique:

- activer en méthode de débruitage - mode : "Non-local means only"

- désactivez le masque

- mettez Scope à 100

En mode "avancé" vous disposez de 5 curseurs:

- Strength

- Detail recovery - permet une première sélection entre les aplats et les textures. Plus les valeurs sont élévées plus les détails réapparaissent

- Gamma - seconde sélection entre les aplats et les textures. Plus le gamma sera faible plus les détails et les textures seront reconstituées

- Maximum patch size : permet d'adapter la taille du "patch" (morceaux) à la taille des objets. En théorie, plus l'image est bruitée plus cette valeur doit être grande. En pratique c'est par l'observation et la minimisation des artefacts dans les transitions - aplats / textures - que l'on sera guidé

- Maximum radius size : plus cette valeur sera grande, meilleure sera théoriquement le débruitage, mais en conséquence les temps de traitement vont considérablement s'accroître.

Ajustement final - Saturation et Contraste local

Ajoutez un nouveau RT-spot, centré sur le "mulot".

Puis ajoutez 2 outils:

- add tool to current spot - "Vibrance and warm cool" - basic

- agissez sur le curseur "vibrance" jusqu'à obtenir l'accroissement souhaité de saturation

- add tool to current spot - "Local contrast & Wavelet" - Wavelet - Advanced

- utilisez "contrast by level" en privilégiant les premiers niveaux

Autres méthodes et outils

D'autres méthodes peuvent être utilisées avec la même finalité:

- méthodes de "Local adjustments"

- "Denoise based on luminance mask" - se sert du même masque que "Recovery based on luminance mask" mais renforce ou affaibli le débruitage "wavelet" - il agit à la manière de "l'equalizer hue" - "avant", alors que "Recovery based on luminance mask" agit "après" en comparant l'image originale bruitée et l'image débruitée.

- "equalizer white-black" et "equalizer blue-yellow red-green" : ils sont l'équivalent de la courbe "luminance curve" dans "Noise reduction" et peu efficaces ici

- "Guided Filter" dans "Blur/grain & denoise" - "Blur & Noise" : vous utilisez le même masque et le même processus "Recovery based on luminance mask" en utilisant les valeurs négatives du curseur "détail"

- "Excluding spots" - qui permettent de restaurer l'image avant l'action du RT-spot "Full image"

- "Median" dans "Flouter/grain & Dé-bruiter" > "Flouter & Brui": peu efficace ici.

- "Netteté des bords" dans "Contrast local & Ondelettes" > "Ondelettes" > "Pyramide 1": si vous voulez flouter une partie de l'image en fonction du niveau de détail.

- autres méthodes de Rawtherapee (non développées ici)

- "Noise reduction" : les courbes "Luminance control" et chromiannce curve permetent une certaine forme de sélection, mais insuffisante ici.

- "Wavelet levels - noise reduction" - avec notamment un "equalizer hue" et l'utilisation de "Local contrast"

Comparaison des outils denoise Comparaison des 3 outils « Denoise » de Rawtherapee

Synthèse

Cet exemple, merci encore à Andy Astbury pour cette excellente image, qui permet de déployer à titre pédagogique 5 méthodes pour différencier l'action entre structures et aplats.

- "Equalizer hue"

- "Recovery based on luminance mask"

- "Scope" - deltaE

- "DCT - Edge detection"

- "Non-local means"

Dans une image difficile il sera probablement nécessaire d'activer les 5 méthodes avec un équilibre toujours difficile à trouver. Le résultat étant affaire de goût de chacun et est assez subjectif.

Notamment:

- le "fond" qui ici est uniforme, pourra poser plus de problèmes si il y a du relief, des structures.

- les couleurs qui ici sont bien séparées, ne vont pas permettre une telle séparation si elles sont plus "mélangées"

- le deltaE qui peut être très perturbé par le bruit chromatique, avec en plus la même remarque que ci-dessus

- "Edge detection" qui lui aussi sera perturbé par un bruit de luminance important

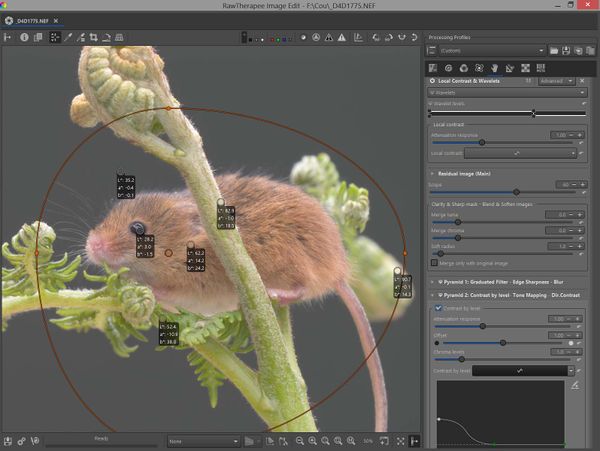

Un moment de folie - utiliser wavelet

A voir dans : Quelques particularités du mode local (par rapport à Lab adjustements) Wavelets

A titre de démonstration....(ne fuyez pas... ce n'est pas si complexe que cela)

Image originale, avec "Exposure compensation" +1.5

La même image avec "Levels Dynamic Range (un)Compression (wavelet local) "Local contrast & Wavelets"

- Tous les réglages par défaut (settings)

- Outil "wavelet pyramid2" activé (advanced)

- scope (wavelet) réglé sur 80

- puis les réglages visibles sur la capture d'écran

- bien sûr l'apparence est subjective, chacun peut accentuer ou réduire les réglage, en ajouter,....

- cette version de "Tone mapping" est différente des autres algorithmes implantés dans Rawtherapee (Fattal "dynamic range compression", Mantiuk "Tone mapping", Log Encoding), elle est spécifique à Rawtherapee Wavelet.

Trois manières d'accroître la texture

Toujours à titre de démonstration, 3 manières d’accroître la texture. Ceci est obtenu par des principes de Tone-mapping J'utiliserais :

- tone-mapping (Mantiuk)

- Retinex

- Wavelet

Préparation - image originale - Venise

Fichier raw (Copyright Sebastien Guyader - Common Attribution-share Alike 4.0): [8]

Traitement "Tone mapping"

Voir dans :Quelques particularités du mode local (par rapport à Lab adjustements) Avec Tone mapping

- remarquez l'utilisation de "normalize luminance" qui maintient à l'image la même moyenne et la même variance que l'image originale

- utilisation du mode "advanced" - "edge stopping" et "scale'

Traitement "Retinex"

Voir dans : Quelques particularités du mode local (par rapport à Lab adjustements) Avec Retinex

- remarquez l'utilisation de "Normalize luminance" qui maintient à l'image la même moyenne et la même variance que l'image originale

- l'usage de "Fast Fourier Transform"

Traitement "Wavelet" (Local contrast & wavelets)

Voir dans : Quelques particularités du mode local (par rapport à Lab adjustements) : Avec Wavelets

- remarquez l'usage de "Levels dynamic range compression", les valeurs de "Attenuation Response", "balance threshold" et "compress residual image"

- essayez aussi "Contrast by levels"

- essayez aussi "Levels directionnal contrast"

- ou une combinaison de ces traitements

Fusion d'images - modes de fusion (merge file)

Voir dans Principes généraux : Fusion d'images

Vous pouvez utiliser dans "Color & light" - "Merge file" qui va vous permettre de simuler la fusion de calques. En effet chaque RT-spot correspond (ce n'est qu'une similitude) à un calque. Le système proposé permet de gérer jusqu'à une prise en compte de 2 RT-Spot et l'image d'origine.

- Le premier "calque" est appelé "Original", il correspond (comme "Excluding spot") aux données avant toute intervention "Local adjustments"

- si vous empilez des RT-spots l'un au dessus de l'autre, par exemple 6:

- "Merge file" fusionnera le 6ème (calque) si le Spot courant est le 6, soit avec le 5ème (Previous Spot), soit avec "Original" (les données d'origine), soit avec une couleur définie dans "background"

- "Merge file" fusionnera le spot courant (par exemple le 3 sur les 6 en cours) avec le 2ème (Previous spot), soit avec "Original" (les données d'origine), soit avec une couleur définie dans "background"

- pour chacune de ces fusions vous disposez de 21 modes de fusions inspirés de ceux de Photoshop (C) (Normal, differences, ....soft light,..., overlay,...)

- pour chacun vous pouvez gérer l'opacité, la prise en compte du deltaE, et un "contrast threshold" (à l'exception du choix "background")

- les "Graduated Filter" (Luminance, Chrominance, Hue) - situés dans "Color and Light" - fonctionnent avec "merge files"

- A titre d'exemple je vais utiliser ces fonctionnalités pour gérer un flou variable (bien sûr vous pouvez faire autre chose)

Préparation

Je passe sur les premières étapes qui sont similaires. Dans ce cas, je choisis "add tool to current spot" = "Smooth - Blur - denoise"

- régler le RT-spot en inverse

- choisir Scope = 90 ou 100 selon l'effet recherché

- régler radius sur une valeur élevée (2000 ou plus - noter l'option FFTW), régler le mode de flou sur "Luminance & chrominance"

Fichier raw (Rawtherapee - Creative Common Attribution-share Alike 4.0): [9]

Créer un deuxième RT-spot

Avec "Add tool to current spot" - "Color & light" - "advanced"

- réglez "Scope color tools" sur 100

Première fusion - mode de fusion "normal"

- Allez jusque l'expander "merge file"

- choisissez dans la liste "Original" - les autres choix :

- "Previous spot" permet la fusion avec le RT-spot précédent (identique à Original - si il n'y a que 1 RT-spot)

- "Background" permet la fusion avec un fond coloré;

- choisissez ensuite dans "Merge with Original or Previous or Background" le mode de fusion et choisissez les réglages : Merge background, Opacity, contrast threshold

- bien sûr vous pouvez utiliser tous les réglages possibles de "Color & Light"

Deuxième mode de fusion - Soft light

Dans la liste des modes de fusion essayez "Soft light (legacy)" (ou un autre mode...)

- choisissez les réglages, essayez...

- remplacez "Original" par "Previous Spot"...notez les différences

Utilisation d'un masque simple pour accroître la sélection de couleur

Voir dans "Principes généraux": Utilisation d'un masque simple

Préparation

- J'ai choisi l'image de la montagne de sel à Pammukale (Turquie).

- C'est une image difficile à traiter, du fait des faibles différences de couleurs entre le ciel et la montagne. De plus cette montagne contient de nombreuses irrégularités.

- Je passe sur les étapes préliminaires similaires aux cas précédents. Notez le réglage de "Scope color tools = 40" qui est un compromis pour permettre de traiter correctement la montagne

- Je propose à titre pédagogique d'accroître de manière très forte la luminance (lightness) et la chrominance de la montagne (ce n'est pas un objectif artistique) : l'objectif est si possible que cette modification ne touche pas le ciel

- j'aurais pu utiliser des "excluding spot", ou si le GUI le prévoit un jour, une délimitation par un polygone; mais à titre pédagogique j'utilise un masque simple. J'aurais pu utiliser plusieurs courbes pour le masque, ou plusieurs masques (dupliquer le RT-spot).

- "Local adjustments" permet la gestion de 2 types de masques:

- 1) ceux qui n'ajoutent ou ne retranchent pas le masque à l'image. On vise l'amélioration de la qualité de la sélection deltaE

- 2) ceux qui utilisent ces différences

- nous sommes ici dans le premier cas (amélioration de la sélection)

Fichier raw (Jacques Desmis - Creative Common Attribution-share Alike 4.0): [10]

Accroître fortement lightness et la chrominance

- Constatez le résultat : les couleurs bavent, le ciel est touché par les changements, alors que je souhaite l'éviter

Élaborer un masque simple

- j'ai pris le parti de ne me servir que de une des 3 courbes LCH (ici L)

- examinez le positionnement de la courbe L(L) : le point d'inflexion est situé à la transition entre zones grises. Pour toutes les courbes - C(C), L(L), LC(H), cette "transition" correspond aux 3 références du RT-spot (chroma, luma, hue)

- ne pas utiliser "blend" : donc il n'y a que la détection de forme qui est améliorée

- vous pouvez utiliser aussi dans "Mask and modifications" - "Show modifications with mask"

Finaliser le résultat

- mettez "mask and modifications" sur "none"

- activez "enable mask"

- agissez si nécessaire sur "Smooth radius mask"

- retouchez éventuellement les courbes "Contrast curve" et L(L)

- passez en mode "advanced" et essayez "Gamma", "Slope", ainsi que "Laplacian thresholdk" (à la place de "Smooth radius")

- certes ce n'est pas parfait, mais nettement mieux....l'objectif est la découverte du fonctionnement des masques.

Pour améliorer le traitement de type masque, 2 solutions s'offrent à vous :

- Dupliquer le RT-spot : si vous dupliquez le RT-spot, à côté du précédent, en changeant légèrement la position du centre (références), vous pouvez utiliser un second masque pour retoucher les "anomalies - incomplétudes" du précédent. De plus cette option permet de retoucher si nécessaire la valeur des traitements (ici lightness, chrominance) et la "partager" entre les 2 RT-spot pour une meilleure homogénéité.

- Utiliser le masque d'un autre outil ouvert (si bien sûr celui-ci est doté d'un masque). Dans ce cas vous conservez les mêmes références (luma, chroma, hue) aussi bien pour élaborer les masques que pour la prise en compte du deltaE (scope)

Prise en compte des deltaE:

- vous pouvez désactiver la fonction cœur de "Local adjustments" - c'est à dire la fonction "Scope" qui prend en compte le deltaE - si vous souhaitez travailler entièrement avec les masques et ignorer "Scope", dans ce cas réglez "Scope=100". A l'évidence la fonctionnalité "Scope" étant désactivée, seule l'utilisation de "blend" sera opérationnelle pour assurer la combinaison masque / image.

- Lorsque vous utilisez les outils des masques "Tools" (Contrast curve mask, chroma mask, gamma mask, etc.), ceux-ci sont sensibles au réglage spécifique du deltaE masque : "Mask deltaE image" ("settings")

Amélioration du résultat avec 'Recovery based on luminance mask'

Nous allons élaborer un masque qui sera utilisé d'une manière différente des autres processus dans RT. Ce masque sera utilisé "en direct" et son analyse va servir à combiner l'image sans l'action de "Color and Light", avec l'image traitée avec "Color and light"

- régler l'arrière plan des masques afin que la lecture des valeurs L*a*b* des "Lockable Color pickers" correspondent aux valeurs réelles : dans "Local adjustments" - "Settings" -"Mask and merge" - "Background color for luminance and color masks = 0"

Selon les réglages de "Recovery based on luminance mask":

- les zones sombres et noires du masque donneront la possibilité de ramener l'image combinée au plus près de l'image originale.

- les zones très claires ou blanches du masque donneront la possibilité de ramener l'image combinée au plus près de l'image originale.

- la zone intermédaire conservera les réglages de "Color and Light".

Image avec réglages "Color & Light" - sans masque

Fichier pp3; [11]

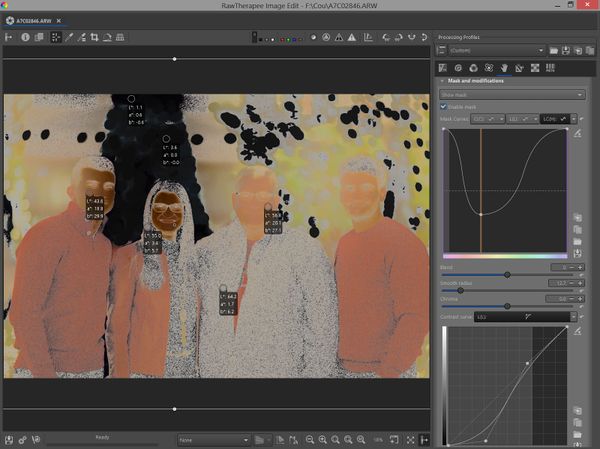

Création du masque

Notez l'utilisation de "Blur mask" avec 'Contrast threshold' et 'Radius'. Cette action permet de relever la valeur des gris dans la partie droite de la montagne de sel pour permettre une action 'légère' de Color and Light' Remarque : l'utilisation 'avancée' de ce masque avec 'Recovery' n'esr pas en opposition avec l'utilisation 'normale' du masque :

- l'utilisation 'normale' va améliorer la sélection

- l'utilisation 'avancée avec recovery' va à nouveau améliorer la sélection.

Récupération des caractéristiques de l'image d'origine

- Assurez vous que le masque est activé dans "Masque et modifications": case "Enable mask" cochée.

- dépliez l'expander "Recovery based on luminance mask"

- agissez sur "Recovery threshold" : plus le curseur sera proche de "2", plus les zones sombres et très claires du masque seront prises en compte, plus ces zones seront ramenées aux valeurs de l'image originale

- agissez sur les curseurs "Dark area luminance threshold" et "Light area luminance threshold" pour inclure ou exclure certaines parties de l'image. Les valeurs correspondantes (ici dark = 32.1 et Light = 85) sont les 2 limites en deçà et au delà desquelles les actions du masque seront progressivement prises en compte.

- agissez éventuellement sur "decay" pour régler la "vitesse" de la décroissance.

- essayez dans "Masque et modifications" de désactiver le masque : case "Enable mask" décochée.

- essayez dans "Masque et modifications"avec masque activé - case "Enable mask" cochée - de remettre à 1 le curseur 'Recovery threshold'

- essayez d'autres réglages de "mask" et des 4 réglages de "recovery"

Que faire quand un masque présente une apparence poivre et sel ?

Lorsque vous utilisez lors de la création du masque, la courbe LC(h), l'image du masque peut être perturbée par une multitude de points noirs et blancs (poivre et sel) qui détournent le masque de son usage. L'image originale choisie ne convient pas car elle est peu bruitée j'en ai choisie une autre qui présente la caractéristique d'un bruit chromatique assez important.

Comment le traiter?

Vous trouverez dans "Settings" > "Show additional settings" > "Mask and Merge", un curseur "Denoise chroma mask".

- agissez jusqu'à obtenir l'effet désiré

Le bruit chromatique peut avoir d'autres incidences sur l'utilisation des masques

Si vous souhaitez utiliser pour l'élaboration du masque la courbe C:, lors de la fusion du masque avec l'image originale des artefacts (paquets) de tâches grisâtres peuvent apparaître. Dans ce cas c'est probablement le bruit chromatique qui est en cause. Procédez comme précédemment.

Utilisation d'un masque avec mélange (blend) du masque et de l'image

Je souhaite ici accroître l'impression de perspective (relief) des Pagodes...

Préparation

- j'aurais pu ici utiliser des outils spécifiques pour accroître l'impression de relief, comme CBDL ("contrast by detail levels") ou Wavelet pyramid (Local contrast & wavelets)

- mais à titre pédagogique je vais utiliser un masque avec "blend"

- je ne retrace pas les démarches de démarrage qui sont identiques

- à retenir : "Scope color" réglée à 40 (arbitraire), et "Color and Light" en mode "advanced"

Fichier raw (Creative Common Attribution-share Alike 4.0): [12]

Réglages du mask - ce qu'il ne faut pas faire

- A titre pédagogique j'utilise 2 fonctionnalités:

- Courbe LC(H) pour sélectionner les couleurs

- "Mask Blur" qui associe un "contrast threshold" et une fonction de floue (blur)

- A noter la case à cocher "FFTW", qui certes consomme des ressources, mais accroît les possibilités ainsi que la qualité des résultats : dans le cas sans FFTW le rayon (radius) est limité à 100, avec FFTW celui-ci est porté à 1000.

Résultats

- Là encore, activez le masque "Enable mask"

- réglez "blend" à votre souhait

- éventuellement ajustez "Smooth radius mask"

- si vous avez activé les réglages "non mask" de "Color and light" (lightness, contrast, etc.), le curseur "Structure spot" va avoir une incidence.

- vous pouvez constater que l'image a maintenant une dominante de couleur... La cause, la courbe LC(H) qui utilise "blend", donc amène un changement de couleur

- essayez de passer la courbe en mode "linear", vous verrez la disparition de la dominante

- conséquence : évitez de mettre plusieurs réglages masques impliquant ou non "blend"

- si vous avez besoin de ces 2 réglages, il est souhaitable comme dans le cas vu plus haut "masque simple" soit de créer un deuxième (ou plus) RT-Spot avec "dupliquer", l'un avec "blend", l'autre sans (ou avec des valeurs de "blend" différentes), soit d'utiliser un autre masque associé à un autre outils.

La bonne démarche

Comme vu plus haut, elle consiste à procéder en 2 étapes, par exemple en créant 2 spots

- le premier pour prendre en compte la courbe LCH..

- le second qui va agir sur la structure

Action sur la structure

Plusieurs outils de type "mask" (en mode "advanced") permettent de modifier la structure

- "Mask Blur" qui associe un "contrast threshold" et une fonction de floue (blur)

- "Mask structure" qui agit directement sur la structure du "mask"

- Pour ces deux outils, les courbes LCH peuvent être inactives (pas de courbes); si vous le souhaitez vous pouvez associer la courbe L(L) de LCH;

- Ces 2 outils "Mask blur" et "Mask Structure" peuvent être associés

- "Mask levels local contrast" et "Mask wavelet levels", peut être associé à la courbe de création de masque L(L) et générer un "local contrast"

Rappel:

- Là encore, activez le masque "Enable mask"

- réglez "blend" à votre souhait

- éventuellement ajustez "Smooth radius"

Comment se servir de Common Color Mask - puis Exemple de combinaison avec une fusion de 2 RT-Spot

Voir dans Principes généraux Masque commun couleur

Ce masque ne fonctionne pas exactement comme les autres masques de "Local adjustments". Il ne vient pas en complément d'un outil, comme par exemple le masque dans "Color and light", mais est un outil en lui même. Vous pouvez vous en servir pour changer l'apparence d'une image - contraste, luminance, couleur....mais aussi texture.

- cet outil fonctionne en prenant en compte le masque qui vient modifier l'image (en plus ou en moins). L'écart des couleurs entre l'image +- masque et l'image originale est régulée par la prise en compte du deltaE - ΔE - et bien sûr des transitions.

- bien sûr vous pouvez l'utiliser aussi en association avec d'autres outils dans le même RT-spot ou non

- l'exemple donné - simple - permet de comprendre le fonctionnement; Il rentre dans la "philosophie" de "Local adjustments"...utiliser le ΔE

Préparation

Je ne reprends pas toutes les étapes, seulement celle de l'ouverture de l'outil

- "Add tool to current spot...", "Common color mask" - "Normal", et à titre pédagogique pas d'autres outils ouverts.

- pour l'élaboration du masque, je vais simplifier au maximum en ne prenant que 2 courbes C(C) et L(L) et en prenant en compte les références du RT-spot

- notez que les 2 curseurs "Add / substract mask luminance" et "Add / substract mask chrominance" ne sont pas à zéro, afin que l'utilisateur ne soit pas dérouté par une absence de réponse du système; les 2 valeurs -10 sont arbitraires et de faible amplitude.

Fichier raw (Creative Common Attribution-share Alike 4.0):[13]

Masque luminance

J'ai choisi une action simple sur la luminance et de relativement faible amplitude.

- remarquez la position du sommet de la courbe sur la transition grise....Le masque "Luminance" s'accorde avec la référence du RT-spot

Masque chrominance

- remarquez la position du sommet de la courbe sur la transition grise....Le masque "Chrominance" s'accorde avec la référence du RT-spot

Preview ΔE

C'est à partir d'ici que vous pourrez jouer sur le deltaE (ΔE), entre "Image +- Masque" et "Image originale"

- essayez d’accroître ou réduire "Scope" (attention c'est le curseur de "common color mask" qui a une action).

- essayez les réglages de "settings" - "Shape detection" : "Threshold ΔE scope", "ΔE decay", "Balance ΔE ab-L", "Balance ΔE C-H"

Show modifications

Allez dans "Show modifications with mask"

- agissez sur "Add / substract mask luminance" et "Add / substract mask chrominance" (j'aurais pu appeler ces curseurs "Opacité")

Résultat

Vous pouvez changer:

- "Scope" (toujours celui de "Common color mask" qui agit sur le ΔE)

- activer "Smooth Radius"... qui va tenter de réduire les artefacts dus à l'élaboration du masque par les 3 courbes - C(C), L(L), LC(H).

- chroma

- agir sur la courbe "Contrast curve"

- essayez dans "settings" - "Scope Mask ΔE image" : ce curseur agit sur la masque et prend en compte le deltaE du masque par rapport au centre du RT-spot, c'est différent du "Scope" (le premier curseur de "Color color mask") qui agit par différence entre l'image originale et le masque que vous avez créé

Passez en mode "advanced"

- agissez sur "Soft Radius", celui-ci va réduire les artefacts entre l'image originale et celle obtenue après "addition" du masque. Par défaut même en mode "normal" (il est à 1) ce qui induit un petit changement - même sans masque - dans "show modifications".

- essayez "Laplacian threshold", et notez les différences avec "Smooth radius"

- essayez "Gamma mask" et "Slope mask"

- essayez de changer la structure par un des outils fournis : "Mask Structure", "Mask Blur", "Mask levels local contrast"

- essayez "Graduated Filter"

Maintenant nous allons améliorer cette image "common color mask" avec l'outil "Merge file" de "Color and Light"

Ajouter un nouveau RT-spot "Color & light - Advanced"

Toujours à titre pédagogique, sans recherche artistique, je vais expliquer comment réaliser 3 modes de fusion parmi les 21 possibles

- ajoutons un nouveau RT-spot

- créons un outil "Color & Light" - "Advanced"

- réglons correctement "Scope" (avec Preview ΔE)

- choisissons 3 réglages pour accroître la luminance, le contraste et la chrominance

Préparer le "merge" (fusion en français)

- choisir "Previous spot", on va donc fusionner le nouveau RT-spot (Color and Light) et le précédent (Common color mask)

Première fusion en mode "normal"

- choisir le mode de fusion "normal"

- arbitrairement j'ai choisi 3 réglages : Merge background = 54.2 prend en compte le deltaE entre les 2 couches; Opacity = 54.2 - environ 50% pour chacun; Contrast threshold = 12.5 - prend en compte les différences aplats / structure

- les deux valeurs 54.2 identiques sont le fait du hasard, il est évident que vous pouvez choisir d'autres valeurs 43, 68, etc.

Deuxième fusion en mode "SoftLight (legacy)"

- changer de mode de fusion et choisir "Softlight (legacy)"

Troisième fusion en mode "Color Burn"

- changer de mode de fusion et choisir "Color Burn"

- bien sûr ces 3 choix de modes de fusion sont arbitraires

- notez les différences de rendus en luminance et chrominance

Plus

Bien sûr, vous pouvez créer autant de "Common color mask" que vous souhaitez, dupliquer ce "masque" près de l'autre avec des réglages proches...

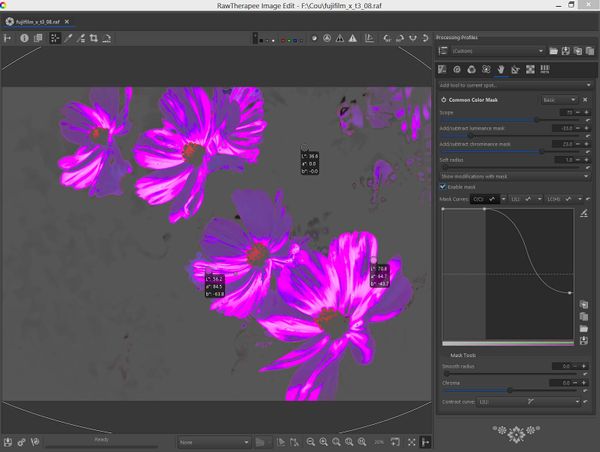

Rappel sur les courbes des masques : C(C), L(L), LC(H)

- Ces courbes permettent de créer le masque

- Pour chacune des courbes la ligne de séparation verticale gris foncé / gris clair représente les 3 références du RT-spot respectivement : Luminance, Chroma et Teinte (hue)

- lorsque la courbe est de premier type ci-dessous, le sommet de la courbe sur la sélection (ici L), la sélection deltaE est améliorée

- lorsque la courbe est de deuxième type ci-dessous - la sélection de teinte pour le masque correspond à la références teinte du RT-spot (le sommet de la courbe sur la sélection - ici H -), comme la courbe inversée, cette couleur (ou L, ou C) sera réduite et l'incidence sur la luminance et la chrominance du masque maximum.

- lorsque la courbe est de troisième type ci-dessous, la sélection de teinte pour le masque ne correspond pas à la références teinte du RT-spot, et la courbe inversée, cette couleur (ou L, ou C) sera réduite et l'incidence sur la luminance et la chrominance du masque maximum.

- J'ai fait le choix pour cette démonstration d'une image à 2 dominantes, magenta (fleur) et vert (feuilllage). Une image plus variée (ciel, mer, montagne, maisons, champs, fleurs, portraits...) va autoriser un usage plus riche des masque, car plus de couleurs / luminance / chrominance à prendre en compte.

- j'ai aussi fait le choix de rester dans la "philosophie" de "Local adjustments", s'appuyer sur les références du RT-spot. J'aurais pu faire l'inverse, comme évoqué dans les courbes ci-dessus. Les résultats auraient été totalement différents.

- De même, j'ai fait le choix dans la fusion (merge) de choisir la même gamme de couleur que pour le masque, j'aurais pu faire un autre choix pour le deuxième RT-spot, en le positionnant sur le feuillage...La fusion aurait été différente, avec moins de variation dans les fleurs...c'est un choix pédagogique

Une approche de traitement complet - Portrait sombre - peau granuleuse - Mairi

Le portrait de Mairi, va être l'occasion d’utiliser plusieurs outils:

- accroître "l'exposition" de l'image pour qu'elle soit moins sombre

- utiliser "CBDL" pour adoucir la peau et "Clarity" pour éclaircir le visage

- réaliser un "graduated filter" pour dégager les ombres du visage à droite

- utiliser 3 "excluding spot" pour "exclure" les yeux et les lèvres du traitement

- utiliser un "masque LC(H)" pour "exclure" les cheveux de l'adoucissement (et donc perte de définition)

- comparer avant après

- remarque : les réglages ont donnés à titre indicatif, tout est fonction de son goût....

Fichie raw (Copyright Pat David - Common Attribution-share Alike 4.0): [14]

Accroître exposition

Exposure + 0.5 J'aurais pu utiliser un RT-spot pour limiter la zone qui sera accrue en exposition au lieu d'un accroissement global de l'exposition.

Utiliser Contrast By Detail Level

- Créer un RT-spot avec un "gros" Spot Size = 47

- Réduction progressive du contraste pour les niveaux 0 à 4

- Clarity à 60

- Scope à 40

Graduated Filter

- Créer un autre spot "Color & Light"

- Graduated filter : luminance -0.6 ; Gradient angle = 5

- vous pouvez aussi (advanced) jouer sur la chrominance

Exclure les yeux et les lèvres

- Créer 3 RT-spot "exluding" sur les yeux et les lèvres

- agir sur Scope (excluding) pour obtenir le résultat recherché

Masque pour exclure les cheveux

- revenir au premier RT-spot

- aller sur masque

- show mask

- utiliser la courbe LC(H)

- repérer la couleur de la peau (séparation des zones grises)

- abaisser la courbe comme sur le graphique (ou similaire)

- agir sur Smooth radius mask

- agir éventuellement sur "gamma", "slope" et "contrast curve" mask

[[File:mairi-mask_1.jpg|600px|thumb|center|Masque

Résultat

- mettre mask sur none

- cocher "enable mask"

Comparaison avant après

Une alternative - remplacer Contrast by detail levels par "wavelet contrast by level"

- Le module "wavelet" est plus performant que Contrast By Detail Levels....il peut sembler plus complexe...vu le nombre d'options.

- Il permet à contrario de CBDL de différencier l'action avec notamment les curseurs "Attenuation Response" et "offset" : au lieu d'avoir une réponse linéaire sur le signal de la décomposition - même amplitude pour les petites valeurs (bruit) et les grosses valeurs - l'amplification (ou la réduction) prend en compte la valeur du signal.

- bien sûr vous disposez aussi d'une fonction "Clarity"

Et bien sûr, vous pouvez utiliser un masque avec "wavelet"

Ajouter une bordure à une image

Généralités

Vous pouvez utiliser les ajustements locaux pour ajouter une bordure à une image. Cette bordure peut être: blanche, noire, grise ou colorée.

Vous pouvez télécharger les fichiers pp3 suivants. Bordure Blanche [15] Bordure Grise [16] Bordure Colorée [17] Bordure Noire [18]

Contrairement à d'autres logiciels qui ajoutent une bordure à l'extérieur de l'image (en accroissant sa taille), cette procédure rogne l'image de la partie concernée par le bord.

Vous pouvez bien sûr personnaliser ces bordures : changer les dimensions (bords verticaux ou horizontaux), changer la couleur. Vous pouvez utiliser "partial paste" pour mettre en place cette modification sur les images de votre choix.

Je tiens à remercier Arturo Isilvia pour sa contribution à ces presets.

Les deux RT-spots

Ce module est constitué de deux RT-spots:

- le premier, utilise le mode "full image". Il rend le fond de l'image noir, blanc, gris ou coloré.

- il met en œuvre l'outil "Color and Light"

- pour les bordures noires, blanches ou grises, l'outil "RGB Tones Curve" est utilisé.

- pour les bordures colorées, c'est l'outil "Color correction grid" qui est utilisé.

- il met en œuvre l'outil "Color and Light"

- le second, est en mode "excluding", utilise un rectangle qui assure les limites de la bordure

Le premier RT-Spot

Détails des réglages du premier RT-Spot - Bords noirs, Gris, Blancs

- Color and Light est utilisé en mode "Avancé"

- Seul l'outil RGB Tone Curve est utilisé. Le réglage correspond à l'exemple ci-dessus (bord gris).

- Dans "Settings" - transition est réglé sur 100.

Détails des réglages du premier RT-Spot - Bords colorés

- Lightness, Contrast, Chrominance sont réglés à -100; Gamma à 0.5

- Choisissez la couleur de votre choix dans "Color correction grid"- ici le réglage de base est vert.

- Dans "Settings" - les réglages suivants sont nécessaires : transition = 100, Scope = 100, DeltaE scope threshold = 10.

Le deuxième RT-Spot

Notez les réglages suivants:

- Scope = 100, Transition = 100, DeltaE scope threshold = 10

- La "shape method" utilisée est "Symmetrical (mouse + sliders)" (dans “Show additional settings” > “Specific cases” > “Shape method”). Vous pouvez facilement changer les valeurs de "Right" et "Bottom" qui permettent ainsi de régler les dimensions de la bordure:

- "Right" change la largeur (partie verticale).

- "Bottom" change la hauteur (partie horizontale).

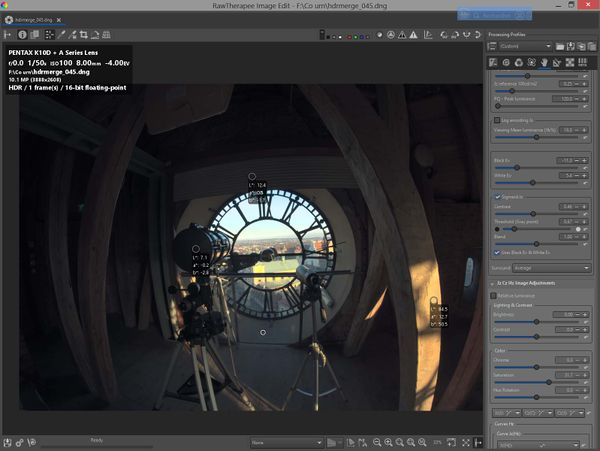

HDR-SDR Première approche : Log encoding – Cam16 – JzCzHz – Sigmoid

Les images à dynamique élevée sont l'un des problèmes récurrents du traitement d'images. Il existe déjà plusieurs algorithmes:

- dans les onglets Exposition et Couleur de RawTherapee qui peuvent être utilisés pour réduire la plage dynamique, avec plus ou moins de succès :Dynamic Range Compression, Shadows/Highlights,

- dans l'onglet Local, Dynamic Range & Exposure, Tone Equalizer, Tone Response Curve, Wavelets, etc.

Ils ont été complétés par un module supplémentaire de codage logarithmique Log Encoding dans l'onglet Ajustements locaux pour faciliter le traitement des images à gamme dynamique élevée. Une version simplifiée, Using the Cam16 and HDR functions du module Color Appearance & Lighting (Ciecam02/16) de l'onglet Advanced du menu principal a également été adaptée aux exigences spécifiques des réglages locaux et étendue pour prendre en compte le pic de luminance HDR. Il inclut également une fonction experimental JzCzHz (en mode Avancé) pour améliorer le traitement HDR.

Attention, les explications ci-après peuvent être sujet à controverse du fait, notamment pour JzCzHz et une partie de Cam16:

- absence de documentation pour JzCzHz;